Optimization 의 큰 틀부터 보자

딥러닝의 학습에서는 최대한 틀리지 않는 방향으로 학습해 나가야 한다.

여기서 얼마나 틀리는지(loss)를 알게 하는 함수가 loss function=손실함수이다.

loss function의 최소값을 찾는 것을 학습의 목표로 한다.

여기서 최소값을 찾아가는 것을 최적화=Optimization 이라고 하고

이를 수행하는 알고리즘이 최적화 알고리즘=Optimizer 이다.

GD를 기본으로 하여 loss function이 최소가 되는 지점, 즉 최적의 가중치를 찾는 방법

옵티마이저는 학습 데이터(Train data)셋을 이용하여 모델을 학습 할 때 데이터의 실제 결과와 모델이 예측한 결과를 기반으로 잘 줄일 수 있게 만들어주는 역할을 한다.

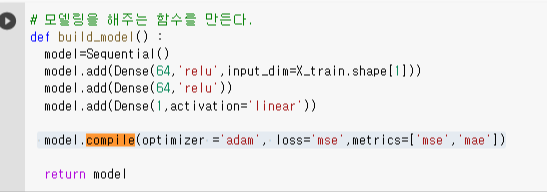

optimizer를 쓰는 곳과 사용 방법

opimizer 는 컴파일에 사용되는 것이며

optimizer =' ' <= 아래 사진에 나와있는 것 중 자신이 원하는 것을 넣어주면 된다.

model.compile(optimizer ='adam', loss='mse',metrics=['mse','mae])

https://mole-starseeker.tistory.com/48

최적화 알고리즘(옵티마이저, Optimizer) 설명

# 최적화 알고리즘(옵티마이저)들인 SGD, RMSProp, AdaGrad, Adam에 대해 설명한다면? *최적화 알고리즘(옵티마이저): GD를 기본으로 하여 loss function이 최소가 되는 지점, 즉 최적의 가중치를 찾는 방법 -

mole-starseeker.tistory.com

'인공지능 > 딥러닝' 카테고리의 다른 글

| 딥러닝 : loss function / compile() 리그레션 문제에서 컴파일 함수의 파라미터 사용법 (0) | 2021.11.30 |

|---|---|

| 딥러닝 : fit 함수에서 배치 사이즈 (batch_size= )와 에포크(epochs=) (0) | 2021.11.30 |

| 딥러닝: Dummy varialbe trap 더미 베리어블 (간단하게) (0) | 2021.11.30 |

| 딥러닝 : Gradient Descent (0) | 2021.11.30 |

| 딥러닝 : 뉴런의 정의 (0) | 2021.11.30 |